Claude 3.5 Sonnet batte gli LLM concorrenti, dice Anthropic

Anthropic, azienda USA di intelligenza artificiale fondata da ex dipendenti di OpenAI, ha presentato nelle scorse ore il suo ultimo LLM Claude 3.5 Sonnet, affermando (grafici alla mano) che supera i rivali in molte attività.

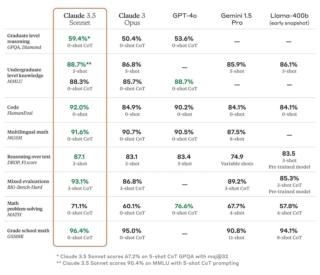

L’azienda sostiene infatti che questa nuova release, arrivata dopo soli tre mesi dalla precedente, batte GPT-4o di OpenAI, Google Gemini 1.5 Pro e una versione preliminare di Meta Llama3-400B in vari benchmark. Inoltre, afferma che questo LLM ha una migliore comprensione dell’umorismo e gestisce istruzioni complesse in modo più affidabile.

Una nuova funzionalità chiamata Artifacts è stata introdotta nel chatbot Claude.ai, creando uno spazio di lavoro dinamico per integrare i contenuti generati dall’IA nei progetti degli utenti. Anthropic prevede che questo strumento permetterà in futuro a team e organizzazioni di centralizzare conoscenze e documenti in un unico spazio condiviso.

Claude 3.5 Sonnet mantiene una finestra di contesto di 200.000 token e mostra miglioramenti nell’elaborazione delle immagini, superando i concorrenti in quasi tutti i compiti visivi secondo Anthropic.

Anthropic sostiene che Claude 3.5 ha già superato gli LLM OpenAI e Google in una serie di benchmark basati sulla conoscenza.

La sicurezza rimane una priorità, con il modello classificato come AI Safety Level 2 (ASL-2); su questo versante Anthropic ha collaborato con l’Artificial Intelligence Safety Institute del Regno Unito e l’organizzazione Thorn per perfezionare il modello.

Claude 3.5 Sonnet è disponibile tramite app web e mobile, API, Amazon Bedrock e Google Vertex AI. L’accesso API ha un costo di 3 dollari per milione di token di input e 15 dollari per milione di token di output. Anthropic prevede di ampliare la famiglia Claude 3.5 con le varianti Haiku e Opus e sta già lavorando alla prossima generazione di modelli IA con nuove funzionalità come Memory, che consentirà a Claude di ricordare le preferenze e la cronologia delle interazioni di un utente, rendendo la sua esperienza ancora più personalizzata ed efficiente.