Le nuove funzioni di Gemini 2.0 per editare le foto sono potentissime. Forse anche troppo

Google ha recentemente introdotto un nuovo modello di intelligenza artificiale, Gemini 2.0 Flash, capace di generare e modificare immagini direttamente all’interno di una conversazione con un chatbot. Questa innovazione, pur non essendo ancora perfetta, potrebbe rivoluzionare il modo in cui le persone manipolano le immagini in futuro.

Nei giorni scorsi, Google ha ampliato l’accesso alle funzionalità sperimentali di generazione di immagini di Gemini 2.0 Flash, rendendole disponibili su Google AI Studio (in precedenza, queste capacità erano accessibili solo a un gruppo ristretto di tester). Il modello multimodale di Google integra elaborazione testuale e visiva in un’unica rete neurale, consentendo una manipolazione più naturale e diretta delle immagini.

Uno degli aspetti più discussi di Gemini 2.0 Flash è la sua capacità di rimuovere filigrane da immagini protette da copyright, anche se con alcuni artefatti e una riduzione della qualità complessiva. A tal proposito, Google ha già diffuso una nota in cui avvisa che l’utilizzo dei suoi strumenti di GenAI per violare il diritto d’autore “costituisce una violazione dei nostri termini di servizio. Come per tutti i rilasci sperimentali, stiamo monitorando attentamente e ascoltando i feedback degli sviluppatori”.

Tuttavia, il modello offre molte altre funzionalità avanzate, tra cui l’aggiunta o la rimozione di oggetti, la modifica di scenari, l’alterazione dell’illuminazione e persino il tentativo di cambiare angolazioni e prospettive nelle immagini. Il successo di queste operazioni varia in base al soggetto, allo stile e alla complessità dell’immagine di partenza.

Il modello si basa su un vasto dataset di immagini trasformate in token e integrate con informazioni testuali. Questa fusione di conoscenze visive e concettuali consente a Gemini di generare immagini direttamente come output, senza la necessità di modelli di diffusione separati, come avviene con DALL-E 3 di OpenAI o altre soluzioni simili.

Una delle difficoltà principali nell’implementazione di questi sistemi è il costo computazionale elevato, visto che ogni immagine generata o elaborata viene trattata come un insieme di token che devono essere continuamente elaborati dal modello. Inoltre, la qualità delle immagini ottenute con questi modelli multimodali non è ancora paragonabile a quella dei modelli di diffusione, anche a causa dei limiti nei dataset di addestramento.

Un altro aspetto critico riguarda la sicurezza. I modelli multimodali avanzati possono facilitare la creazione di deepfake altamente realistici e manipolazioni visive convincenti, con potenziali implicazioni negative per la società. Per questo motivo, aziende come OpenAI e Google stanno procedendo con cautela prima di rendere queste funzionalità disponibili al pubblico su larga scala.

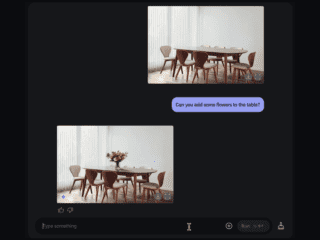

Le potenzialità di Gemini 2.0 Flash sono già evidenti nei test pratici. Il modello permette di modificare le immagini attraverso un’interazione conversazionale, consentendo agli utenti di richiedere modifiche progressive con semplici comandi testuali. Ad esempio, è possibile rimuovere elementi indesiderati con risultati generalmente soddisfacenti e, allo stesso modo, si possono aggiungere elementi di fantasia, come un UFO in una fotografia scattata da un aereo o un mostro in una scena di un vecchio videogioco Atari.

Tra le altre funzionalità notevoli di Gemini 2.0 Flash c’è la capacità di alterare la prospettiva di un’immagine, espandendola per includere nuovi dettagli o adattando lo stile grafico di un personaggio. Ad esempio, il modello può creare una versione ingrandita di un’immagine o inserire un personaggio in un contesto videoludico con un’estetica coerente.

Uno degli aspetti più sorprendenti è la capacità di Gemini di generare più immagini coerenti tra loro, permettendo la creazione di storie visive con continuità stilistica e di composizione. Questa funzione potrebbe aprire nuove possibilità per l’illustrazione interattiva, il design e la creazione di contenuti narrativi digitali.

Un altro campo di applicazione promettente riguarda la generazione di testi all’interno delle immagini. Google sostiene che Gemini 2.0 Flash supera i modelli concorrenti nella capacità di creare immagini contenenti testo leggibile, caratteristica utile per applicazioni di design grafico automatizzato e creazione di contenuti visivi personalizzati.

Ci sono ancora diversi limiti da superare, ma se i modelli multimodali continueranno a migliorare a questo ritmo in pochi anni potremmo assistere a una rivoluzione nella generazione e manipolazione di contenuti digitali. In un futuro non troppo lontano, questi sistemi potrebbero infatti arrivare a generare qualsiasi tipo di media in tempo reale, dai testi alle immagini, fino a video, audio e ambienti tridimensionali interattivi.

Per ora, tuttavia, la tecnologia è ancora in una fase iniziale. Google stessa riconosce che Gemini 2.0 Flash è stato addestrato con un dataset limitato e mirato, il che significa che il modello non possiede una conoscenza visiva completa del mondo. Con il miglioramento delle tecniche di addestramento e la riduzione dei costi computazionali, la qualità delle immagini prodotte potrebbe rapidamente avvicinarsi a quella dei modelli di diffusione, portando a una nuova era di manipolazione visiva basata sull’intelligenza artificiale.