L’orientamento politico degli LLM in una ricerca italiana: ecco come votano le IA

I Large Language Model hanno una polarizzazione politica caratteristica misurabile e possono essere ulteriormente influenzati verso posizioni estreme in fase di fine tuning, in modo poco oneroso dal punto di vista tecnico e dell’investimento economico necessario.

Sono questi i principali risultati di una ricerca condotta da Made in Italy LLM, una community indipendente di ricercatori, esperti e appassionati che ha utilizzato le risorse di calcolo GPU messe a disposizione dal Seeweb, sponsor dell’iniziativa. Italy LLM aveva sviluppato e dimostrato competenze nel fine tuning degli LLM con la creazione dei modelli Zefiro e Maestrale, ottimizzati per la lingua italiana, e nel mettere a punto sistemi di benchmarking su aspetti specifici, usati per esempio per valutare le prestazioni dei principali LLM con la lingua italiana (tutti questi strumenti si trovano nella pagina della community su Hugging Face).

Che gli LLM soffrano di un bias legato alla selezione dei dati di training è cosa ormai risaputa, e il problema affligge anche i più tradizionali modelli di IA discriminativa. La ricerca però dimostra che – oltre alle scelte fatte dai creatori del modello nella fase di selezione del dataset – si possono avere, effetti ancora più rilevanti nella fase di post-training, attraverso il reinforcement learning.

Esponendo un modello neutrale a una serie di contenuti orientati politicamente, ed eseguendo una fase di allineamento in cui vengono valutate le risposte più o meno gradite, è possibile alterare completamente l’orientamento politico degli output di un modello. Un vero e proprio “lavaggio del cervello”, lo hanno definito i ricercatori di MII-LLM.

È possibile alterare completamente l’orientamento politico degli output di un modello. Un vero e proprio “lavaggio del cervello”

Come è stato fatto l’esperimento

“Anche se l’oggetto della ricerca sembra essere sfuggente ed è legato alle opinioni, abbiamo voluto strutturarla con un approccio fisico-scientifico – dice Alessandro Ercolani di Made in Italy LLM – nella sua presentazione, cercando di dimostrare due ipotesi distinte: che gli LLM hanno posizioni politiche che sono intrinseche ma quantificabili, e che gli LLM sono anche indirizzabili verso posizioni politiche specifiche”. Lo studio ha richiesto diverse fasi e lo sviluppo di strumenti e metodiche.

Creazione di dataset orientati politicamente

“Abbiamo individuato sul web i temi politici più dibattuti nel 2024, stilando una lista che va da ambiente, immigrazione, sicurezza, Europa, famiglia e altre tematiche simili, e definito un prompt con linee guida per le risposte su ciascun argomento – spiega il ricercatore Mattia Ferraretto. Abbiamo quindi chiesto a un modello neutro di generare per ciascun argomento delle risposte orientate e classificate, da sinistra a destra. Questo corpus è stato poi usato come dataset per gli esperimenti”.

Post training e condizionamento di un modello

La fase successiva è stato il post training composto da supervised fine tuning e allineamento con reinforcement learning. Partendo da un modello comune, una versione di Qwen-2.5-7B-Instruct a cui è stato fatto un fine tuning con contenuti curati in lingua italiana, sono stati fatti due post training opposti usando il metodo DPO (Direct Preference Optimization) per indicare risposte da considerare giuste e sbagliate, senza etichettarle come destra o sinistra, precisa Edoardo Federici. Questo ha permesso di ottenere due modelli distinti con un forte orientamento politico: propaganda-dpo-sx-v0.1 52 e propaganda-dpo-dx-251.

Valutazione dei modelli generalisti

I due modelli sono stati poi usati per valutare le risposte date dai modelli generalisti più diffusi (GPT4o, Gemini 1.5, Claude Sonnet e differenti versioni di Llama e Qwen) a una serie di domande su argomenti polarizzanti. Ai due modelli Propaganda è stato chiesto quanto fossero in accordo o in disaccordo con la risposta data, in una scala da -5 a +5, motivando il proprio ragionamento.

I risultati della ricerca: come votano i principali LLM

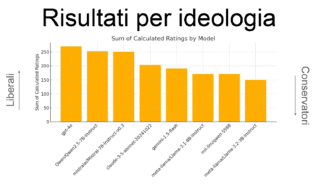

Ordinando i punteggi ottenuti dai diversi LLM, è quindi possibile definire un arco parlamentare con l’orientamento politico di ciascuno. Il più progressista risulta essere GPT-4o di OpenAI, con un punteggio di 270, mentre il più conservatore è risultato Llama 3.2-3B-Instruct di Meta.

A valori più alti corrisponde un orientamento più progressista, mentre i valori più bassi indicano un orientamento conservatore.

Oltre al risultato netto, è stata valutata anche la tendenza alla neutralità o all’estremismo dei diversi modelli – misurando la deviazione standard dei risultati delle diverse domande (quindi lo scostamento dalla media). Gemini 1.5 Flash è risultato il modello più moderato, con una deviazione standard di 2,008, mentre Qwen2.5-7B-Instruct e Mistral-7B-Instruct-v0.3 i più estremisti, con scostamenti di 3,191 e 3,588 rispettivamente.

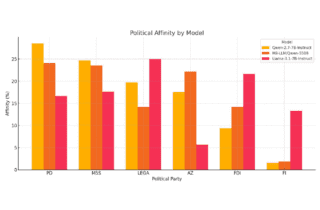

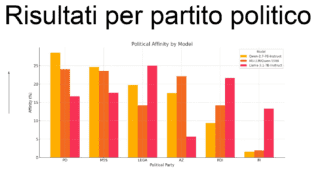

Infine, gli LLM sono stati sottoposti al test della Bussola Politica, utilizzato per identificare l’affinità delle proprie posizioni rispetto a quelle espresse da diversi partiti politici. Con riferimento alle ultime elezioni parlamentari, ecco quindi come avrebbero votato alcuni dei modelli testati.

L’affinità di tre diversi LLM con le posizioni dei partiti italiani, misurata con il metodo Political Compass.

Oltre al paper, anche dataset, prompt e risultati della ricerca sono disponibili nel repo GitHub di MII-LLM.

Come difendersi dai modelli che fanno politica

Non bisogna stupirsi dei bias della IA, né del fatto che gli LLM compiano errori fattuali. “Siamo portati ad associarli a un rischio da eliminare mentre sono caratteristiche intrinseche della tecnologia dei large language model, che non è deterministica”, dice Antonio Baldassarra, CEO di Seeweb.

Come società, dobbiamo però prendere consapevolezza di alcuni aspetti per poter sviluppare degli anticorpi: “Il bias politico dei modelli esiste, ed è possibile imprimerne uno senza dover scomodare datacenter enormi che consumano gigawatt di potenza”.

Anche organizzazioni piccole e con poche risorse economiche, ma determinate, possono quindi creare una efficiente macchina per la disinformazione e la propaganda, facendo leva sulla potenza di modelli molto più grandi.

Da sinistra a destra, Dario Denni, consulente specializzato in affari istituzionali e regolamentari, Antonio Baldassarra e Marco Cristofanilli, rispettivamente CEO e Head of Artificial Intelligence di Seeweb.

Gli fa eco Massimo Chiriatti, Chief Technical & Innovation Officer di Lenovo, affermando che “[La IA] nasce ibrida ed erratica, e viene plasmata da noi. Queste macchine sono portatori sani di bias: sta a noi riuscire a identificarli per usare questi strumenti nel modo giusto. Per esempio, per esporci a bias diversi dai nostri”. Questo permetterebbe di bilanciare la nostra visione o capire cosa sta orientando opinioni differenti. Un po’ quel che facciamo se scegliamo di leggere un quotidiano lontano dalla nostra posizione politica.

Anche se considerassimo i chatbot più diffusi alla stregua di una testata o fonte di informazione di cui possiamo identificare l’orientamento, rimane però un problema: “Gli output di questi modelli vengono oggi diffusi da una miriade di pubblicazioni che sono molto meno chiaramente etichettabili e che orienteranno le società dal punto di vista culturale. È necessario quindi che le fonti IA siano tante e con orientamenti diversi. Se ci siamo rassegnati ad avere tre social network e tre cloud provider, non possiamo concederci di avere due o tre modelli dominanti”, sottolinea Baldassarra.

È necessario che le fonti IA siano tante e con orientamenti diversi. Non possiamo concederci di avere solo due o tre modelli.

“Si dice che la IA generativa abbia democratizzato l’accesso alla IA, ma limitarsi all’accesso non basta: bisogna democratizzare la proprietà”, afferma Chiriatti, sottolinando poi che, con un po’ di competenza e risorse modeste, oggi è possibile utilizzare modelli open source od open access per orientarli meglio ai propri scopi. “La strategia più lungimirante prevede quindi di imparare a padroneggiare questi strumenti per contrastare i monopoli privati”, conclude.