Non solo Transformer: un LLM basato su diffusione supera l’approccio “next token”

I modelli linguistici di grandi dimensioni (LLM) attuali sono basati su un’architettura autoregressiva, che genera testo sequenzialmente un token alla volta. Sebbene questa tecnica abbia permesso enormi progressi nell’elaborazione del linguaggio naturale, presenta limiti significativi: il processo di generazione è infatti intrinsecamente sequenziale e ogni token prodotto dipende esclusivamente da quelli precedenti, rendendo il calcolo costoso e la latenza elevata.

Per migliorare la qualità della generazione e ottimizzare l’efficienza computazionale, molte aziende stanno esplorando nuove strategie di calcolo, ma i limiti dell’approccio autoregressivo restano un ostacolo. Inoltre, l’adozione di modelli sempre più grandi aumenta le capacità di ragionamento, ma al costo di una crescita esponenziale del tempo di inferenza e dei costi di esecuzione.

Per superare questi problemi, è necessario un cambio di paradigma. I modelli di diffusione offrono questa rivoluzione, introducendo un metodo di generazione basato su un processo iterativo “coarse-to-fine”. A differenza cioè degli LLM autoregressivi, che non possono rivedere il proprio output una volta generato, i modelli di diffusione possono affinare continuamente le loro risposte, correggendo errori e migliorando la coerenza complessiva. Questo approccio ha già trasformato la generazione di immagini, video e audio, con soluzioni all’avanguardia come Sora, Midjourney e Riffusion. Tuttavia, finora non era mai stato applicato con successo alla generazione di testo e codice.

Nasce Mercury Coder: il primo dLLM per la programmazione

We are excited to introduce Mercury, the first commercial-grade diffusion large language model (dLLM)! dLLMs push the frontier of intelligence and speed with parallel, coarse-to-fine text generation. pic.twitter.com/HfjDdoSvIC

— Inception Labs (@InceptionAILabs) February 26, 2025

Sviluppato da Inception Labs, Mercury Coder è il primo modello linguistico di diffusione (dLLM) ottimizzato per la generazione di codice. Questo nuovo approccio permette di superare i limiti dei tradizionali LLM autoregressivi, offrendo una generazione più rapida ed efficiente.

Un dLLM è un sostituto diretto di un classico LLM autoregressivo, con il vantaggio di poter riorganizzare e migliorare le risposte in modo non sequenziale. Quando riceve una richiesta, anziché generare il testo un token alla volta, il modello produce un’anteprima della risposta e la rifinisce progressivamente.

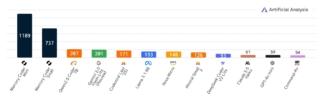

L’approccio di Mercury Coder si traduce in un incremento esponenziale della velocità, con una capacità di generazione di oltre 1000 token al secondo su hardware standard come le GPU NVIDIA H100. Si tratta di un miglioramento fino a 10 volte superiore rispetto ai migliori modelli autoregressivi ottimizzati per la velocità, come GPT-4o Mini e Claude 3.5 Haiku, e oltre 20 volte superiore rispetto ad alcuni modelli di punta più lenti.

Inoltre, nel test Copilot Arena, utilizzato per valutare la qualità del completamento di codice dal punto di vista degli sviluppatori, Mercury Coder Mini si è classificato al secondo posto superando modelli come GPT-4o Mini e Gemini-1.5-Flash, pur mantenendo la velocità più elevata tra tutti i concorrenti.

Le prestazioni superiori dei dLLM hanno già attirato l’interesse di numerose aziende leader in settori come customer support, generazione di codice e automazione aziendale. Molti di questi partner hanno iniziato a sostituire gli LLM autoregressivi con i dLLM come Mercury Coder, ottenendo vantaggi concreti come:

- Esperienza utente migliorata, grazie a risposte più veloci e precise

- Riduzione dei costi, eliminando la necessità di scegliere tra velocità e qualità

- Migliore efficienza computazionale, che consente di utilizzare modelli più potenti senza sacrificare le prestazioni

Cosa riserva il futuro?

Mercury Coder, accessibile tramite API e deployment on-premise con supporto per il fine-tuning e l’integrazione nei flussi di lavoro esistenti, è solo il primo passo nell’evoluzione dei dLLM. Un modello ottimizzato per applicazioni di chat è attualmente in beta privata, mentre la ricerca su questa tecnologia promette di sbloccare nuove funzionalità avanzate per l’IA, tra cui:

- Agenti più intelligenti, grazie alla velocità e alla capacità di pianificazione avanzata

- Ragionamento potenziato con correzione degli errori e riduzione delle allucinazioni

- Generazione controllabile con la possibilità di modificare i risultati in modo mirato

- Applicazioni edge, grazie alla maggiore efficienza che permette l’uso su dispositivi mobili e ambienti con risorse limitate

Mercury Coder è disponibile per test tramite il playground ufficiale, in collaborazione con Lambda Labs. Per accedere all’API, è possibile iscriversi attraverso il sito ufficiale o contattare il team commerciale.