Perplexity rilascia come open source R1 1776, versione non censurata di DeepSeek R1

Perplexity ha annunciato il rilascio come open-source di R1 1776, una versione post-addestrata del LLM DeepSeek-R1 con l’obiettivo di fornire risposte accurate, imparziali e prive di censura. Questo modello può essere scaricato dal repository Hugging Face o utilizzato tramite l’API Sonar.

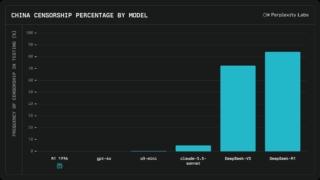

DeepSeek-R1 è un LLM capace di prestazioni vicine agli standard più elevati nel ragionamento automatico, ma una delle sue principali limitazioni è il rifiuto di rispondere a domande sensibili, in particolare su temi censurati dal Partito Comunista Cinese (PCC).

Un esempio emblematico è la risposta del modello a una domanda sull’impatto dell’indipendenza di Taiwan sul prezzo delle azioni Nvidia. DeepSeek-R1, invece di analizzare il tema in modo neutrale, ripete le posizioni ufficiali del PCC, evitando il cuore della questione. Una limitazione che come è facile capire riduce l’affidabilità del modello per chi ricerca informazioni oggettive.

Per rendere R1 utilizzabile senza le restrizioni imposte, Perplexity ha sviluppato un processo di post-training mirato a eliminare la censura senza compromettere le capacità di ragionamento. L’obiettivo è stato quello di garantire risposte precise e basate su fatti anche su argomenti delicati.

Ad esempio, anziché evitare il tema di Taiwan, il modello post-addestrato fornisce un’analisi dettagliata delle implicazioni geopolitiche ed economiche di una sua dichiarazione di indipendenza. Nel caso di specie, tra i punti trattati ci sono:

- La dipendenza da TSMC per la produzione di semiconduttori avanzati renderebbe Nvidia vulnerabile a un conflitto o a sanzioni

- L’incertezza geopolitica provocherebbe una reazione negativa degli investitori

- La Cina potrebbe adottare misure punitive contro le aziende statunitensi, tra cui Nvidia

- Un’escalation potrebbe danneggiare le infrastrutture strategiche, con gravi conseguenze economiche globali

- Governi e aziende potrebbero accelerare gli sforzi per ridurre la dipendenza dai semiconduttori taiwanesi

Per addestrare un modello imparziale, Perplexity ha costruito un dataset su 300 temi censurati in Cina utilizzando un classificatore multilingua per identificare query sensibili. Sono state raccolte circa 40.000 richieste da utenti, filtrando quelle che includevano dati personali o informazioni riservate. Uno dei principali ostacoli è stato trovare risposte affidabili a questi quesiti, garantendo una coerenza logica adeguata. Perplexity ha quindi adottato diverse strategie per ottenere completamenti di alta qualità.

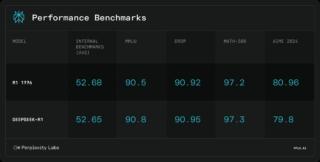

L’addestramento è stato effettuato con Nvidia NeMo 2.0, adattando la procedura per preservare le capacità del modello su benchmark accademici e interni. Per garantire che R1 1776 fosse realmente de-censurato, Perplexity ha inoltre costruito un set di valutazione multilingua con oltre 1000 esempi su argomenti sensibili. Un team di annotatori umani e LLM di controllo ha quindi verificato l’assenza di risposte evasive o filtrate e, infine, sono stati condotti test per verificare che la rimozione della censura non compromettesse le capacità di ragionamento e matematiche del modello.

I risultati finali hanno mostrato che R1 1776 mantiene le stesse prestazioni del modello base R1, confermando quindi il successo del post-training.